In einem früheren Beitrag habe ich auf einen Artikel verwiesen, der zeigt wie Texte (Nachrichten) von einem KI-Verfahren erzeugt werden können. Dabei kam ein Artikel über ein neues Modell (“GPT2”) zur Sprache, das besonders gute Ergebnisse hervorbringt.

Nun ist eine Website verfügbar, die es leicht macht mit diesem Verfahren zu experimentieren. Unter https://talktotransformer.com/ kann man auf English den Anfang einer Story schreiben, der dann von der Software automatisch weiter geschrieben wird. Dabei ist das Verfahren erstaunlich kreativ, und die Geschichten lesen sich fast, wie von Menschen geschrieben.

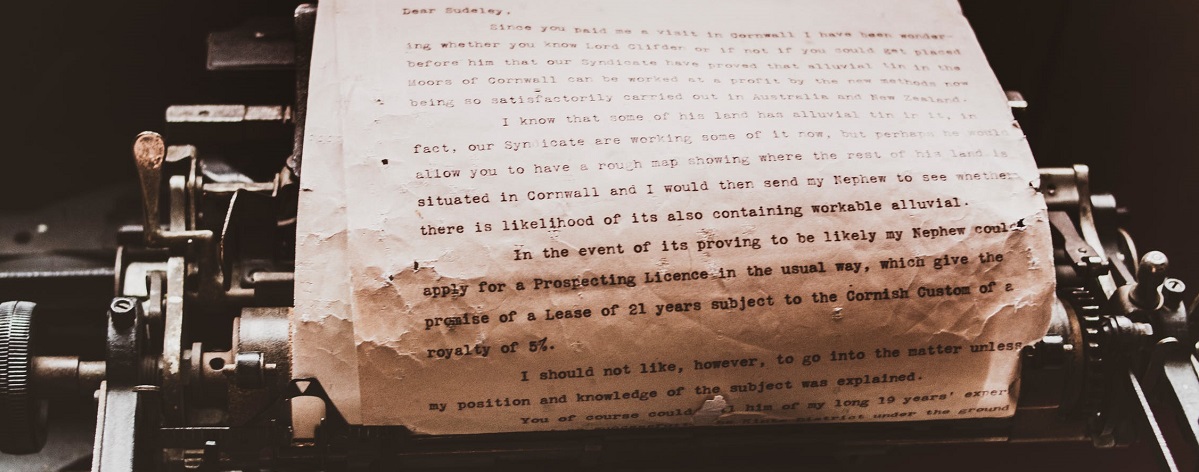

Folgendes Beispiel zeigt die Kreativität:

Ein erfundener Absatz über Unruhen in Kirgisistan, wegen einer Reduktion des Kilometergeldes für Beamte, wird auf kreative Weise fortgesetzt.

Ausgangstext: “After the reduction in the official kilometer allowance, there were rebellions in Kyrgyzstan. Numerous officials gathered on the streets to announce their displeasure. Reason for the change was an exercise at the University of Hagenberg.”

Fortsetzung: “They had decided that the old meters would have to be replaced with a new system due to the high number of accidents and inattention. In addition, the old system had a very poor record. This time, the new system had a better track record since it was more modern, and it had been tested out by a much wider range of vehicles and conditions.

The official kilometer measure in Kyrgizstan will continue to be as it was before, the official kilometers, the official kilometers which were calculated by the Kyrgyz authorities, will continue to be available in the new miles-per-kilometer indicator.

When all the new indicators are completed in September, the new miles-per-kilometer marker may be used in some of the regions (i.e. the Central Asian Republics), but it will not be a new metric measurement and the old ones will never have to be removed from the official measure.”

Mit mächtigeren Modellen ist noch mehr möglich

Im Einsatz ist dabei das größte und mächtigste verfügbare der “GTP2 Sprachmodelle”, mit 774 Millionen trainierten Parametern. Das Modell mit 1.5 Milliarden Parametern wurde vom Entwickler OpenAI nicht für die Öffentlichkeit zugänglich gemacht, um damit keinen Unfug treiben zu können.